Auf heise.de (Link) inkl. Link zu decoder.de (Link) las ich gestern:

„Kürzlich hat Luma AI sein Text-zu-3D-Tool Genie auf den Markt gebracht, das die Erstellung von 3D-Modellen über das Web oder iOS ermöglicht. Generative KI-Modelle konzentrieren sich zunehmend auf 3D-Inhalte und Videos als nächstes Ziel nach Text und Bild.“

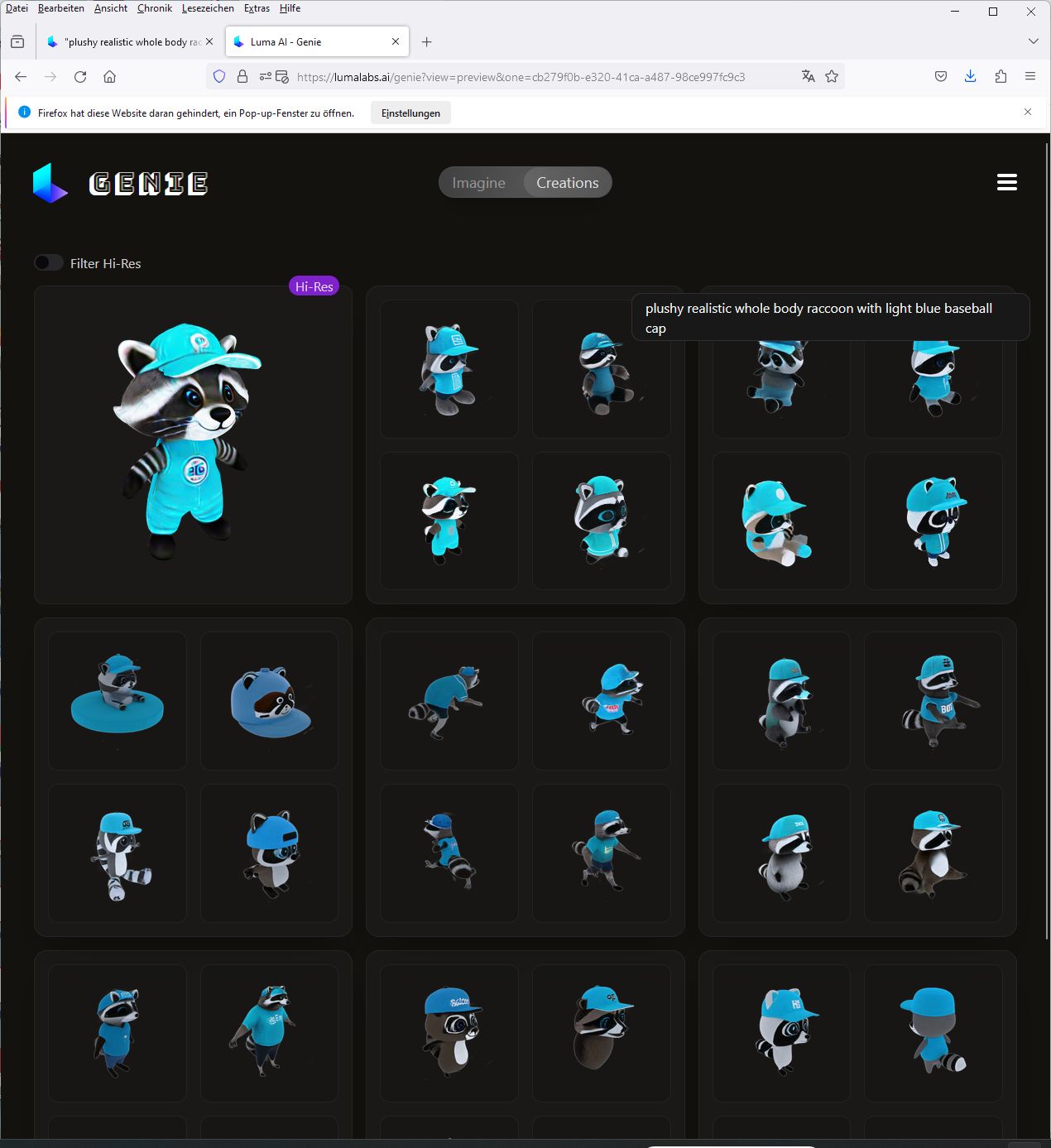

„plushy realistic whole body raccoon with light blue baseball cap“

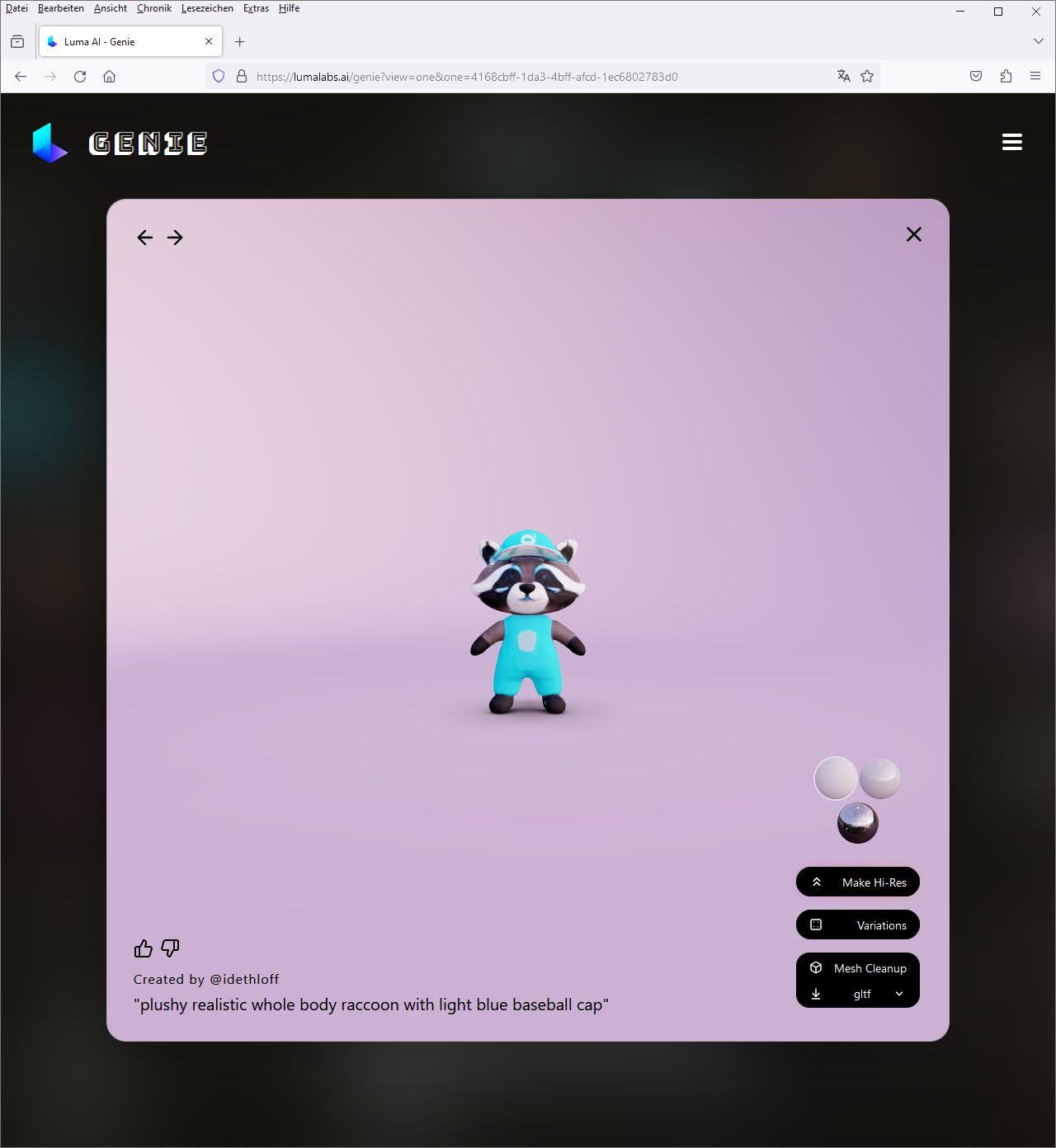

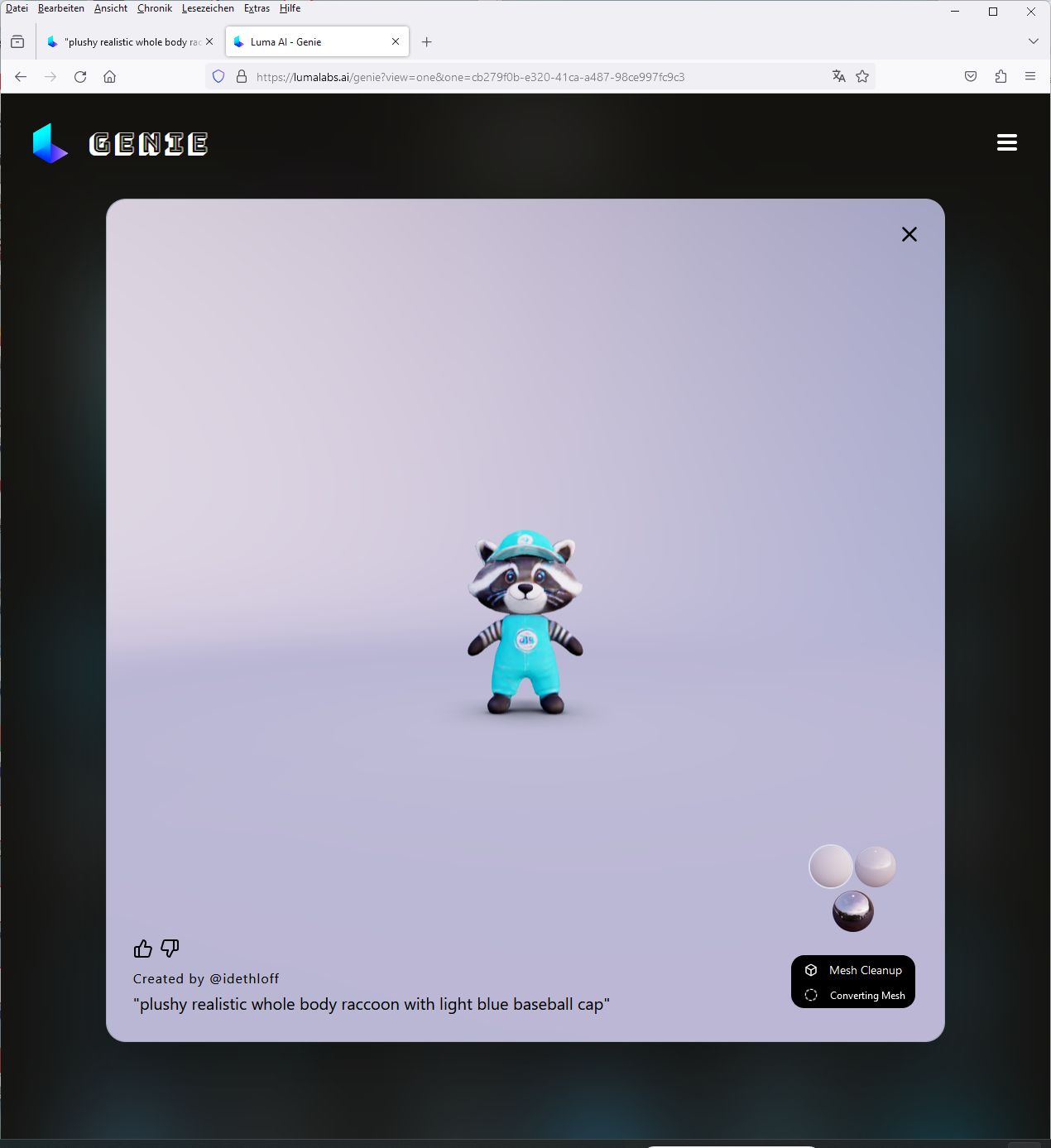

Erzeugtes 3D-Modell-Testergebnis (als Video dargestellt);

Download des 3D-Modells s. ganz unten auf dieser Seite

***

Testbericht

Wenn man bedenkt, wie aufwändig es ist, selbst ein 3D-Modell manuell zu erstellen, hat ein derartiges „Text-zu-3D-Tool“ sehr viel Potential!

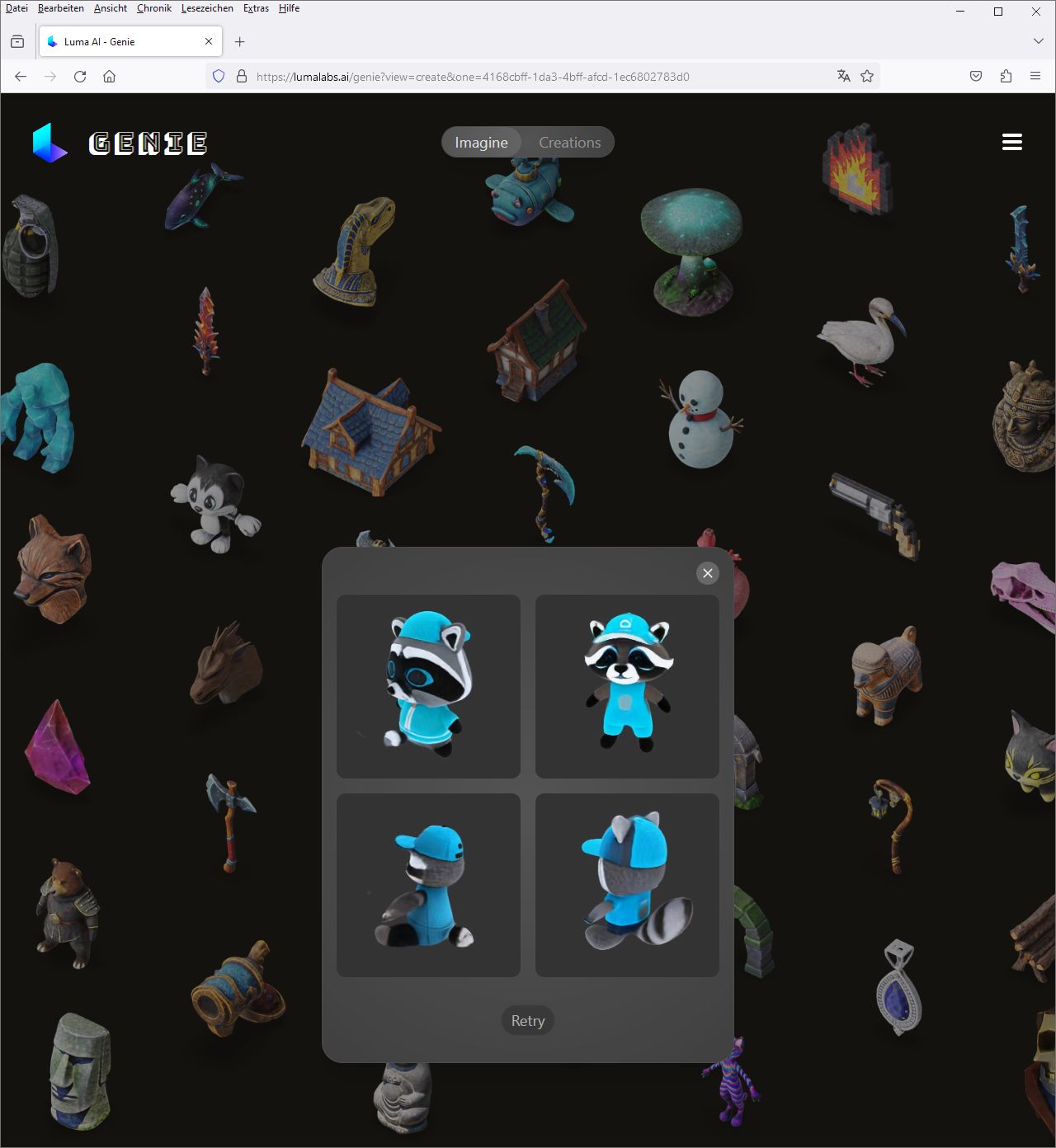

Ja, ein Textbefehl erzeugt in wenigen Sekunden vier simple 3-D-Modelle. Allerdings musste ich mit den Prompts mehrfach experimentieren, um in etwa ein Ergebnis zu erhalten, das meinen Vorstellungen entsprach. Wenn ich einen Waschbär haben möchte, dann bitte nicht nur einen Kopf und möglichst auch ansatzweise alle Körperteile – und man sollte noch erkennen, das ein Waschbär gemeint war… Aber das ist kein wirkliches Problem und das Ergebnis fand ich in seiner Einfachheit sehr beeindruckend.

Anschließend in Blender hochgeladen, hier das von Genie erzeugte 3D-Modell (GLB) einmal in der Blender-Wireframe-Ansicht:

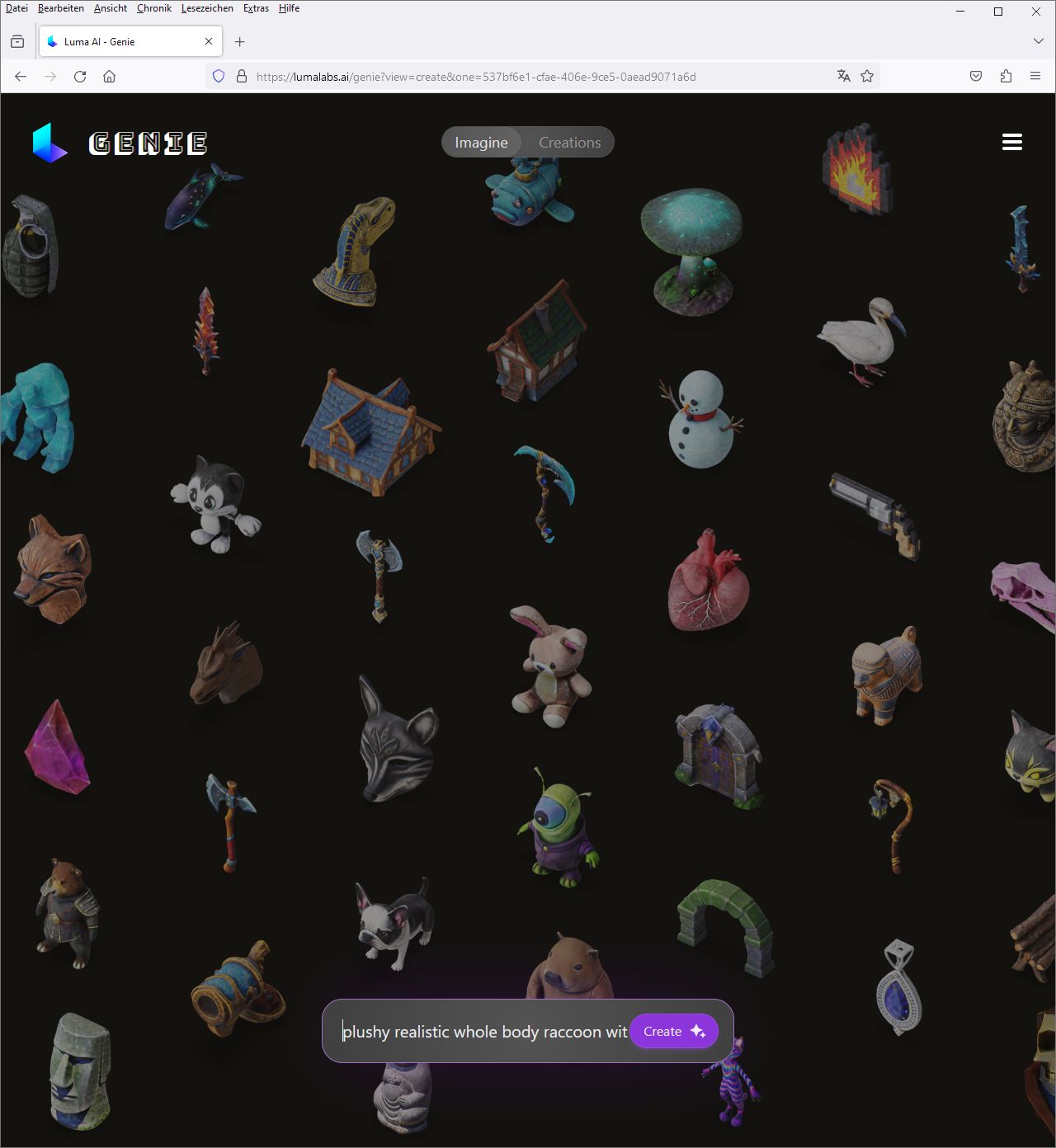

Schritt 1: Persönliche Anmeldung in Webanwendung https://lumalabs.ai/genie?view=create

Schritt 2: Prompt „plushy realistic whole body raccoon with light blue baseball cap“

Schritt 3: Nach einigen Sekunden vier simple Ergebnisse

Schritt 4: Auswahl von Ergebnis 2 durch Anklicken

Schritt 5: Auftrag „Make Hi-Res“ und Warten (Reload kann nicht schaden – habe dies nach 1h gemacht und das Ergebnis war schon da…)

Schritt 6: Export der „Hi-Res“-Variante (Mesh Cleanup, obj, glb, stl, usdz …)

Ergebnis zum Ausprobieren / Download