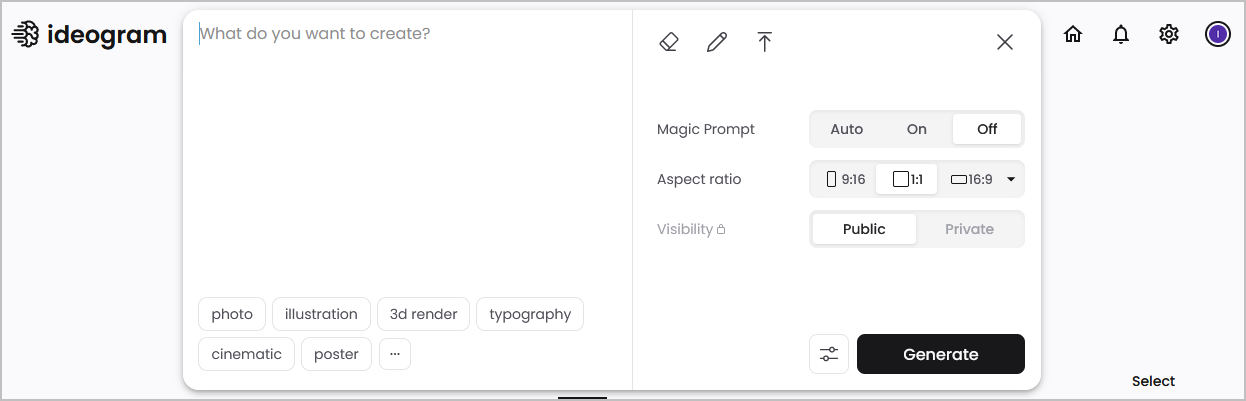

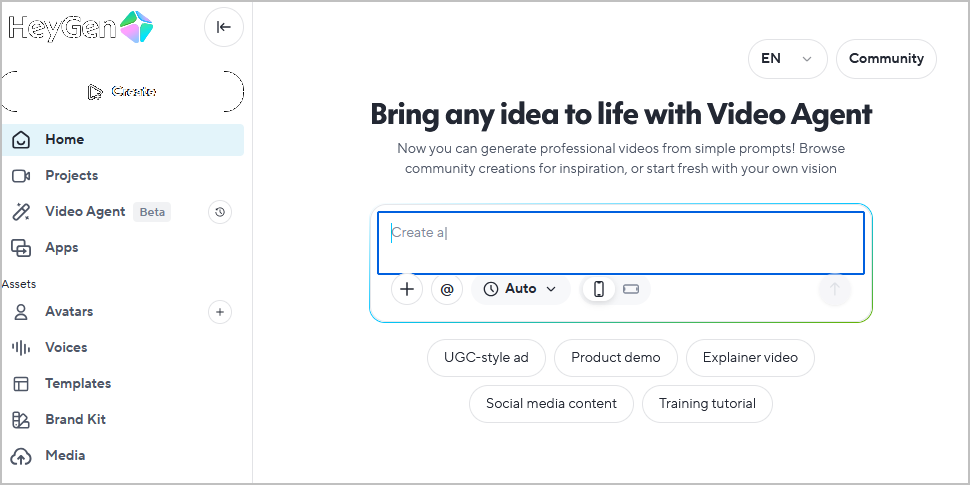

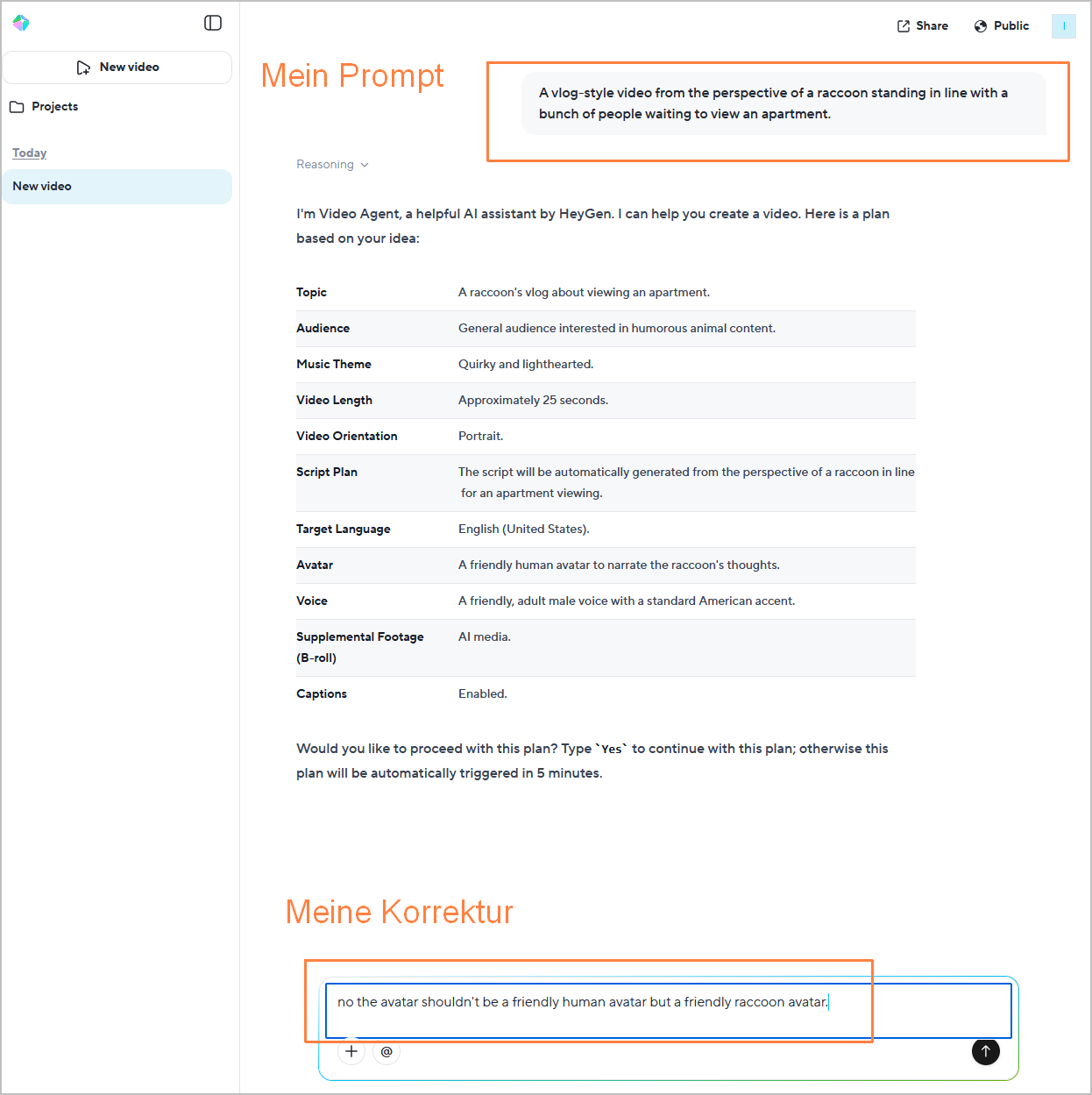

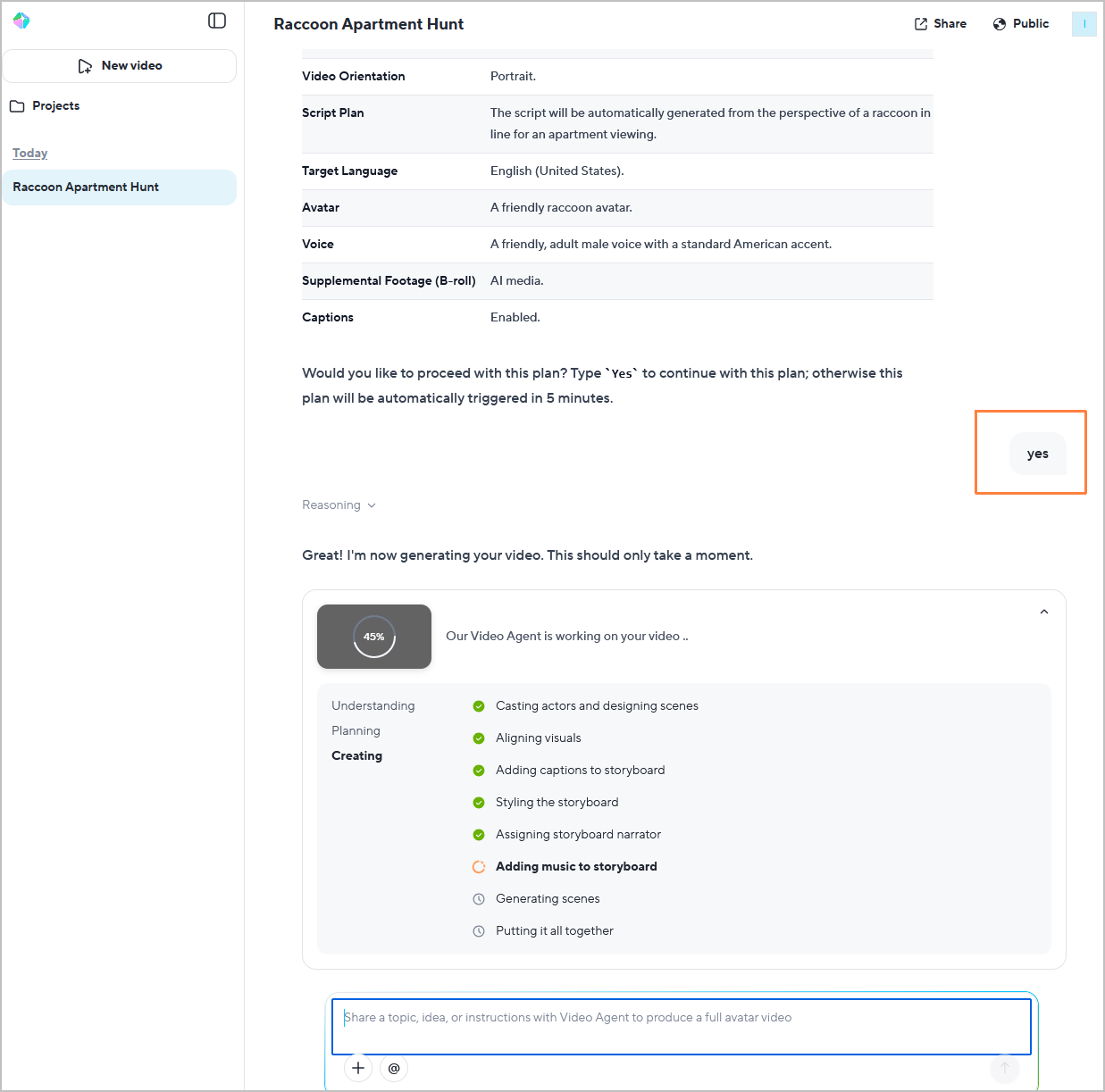

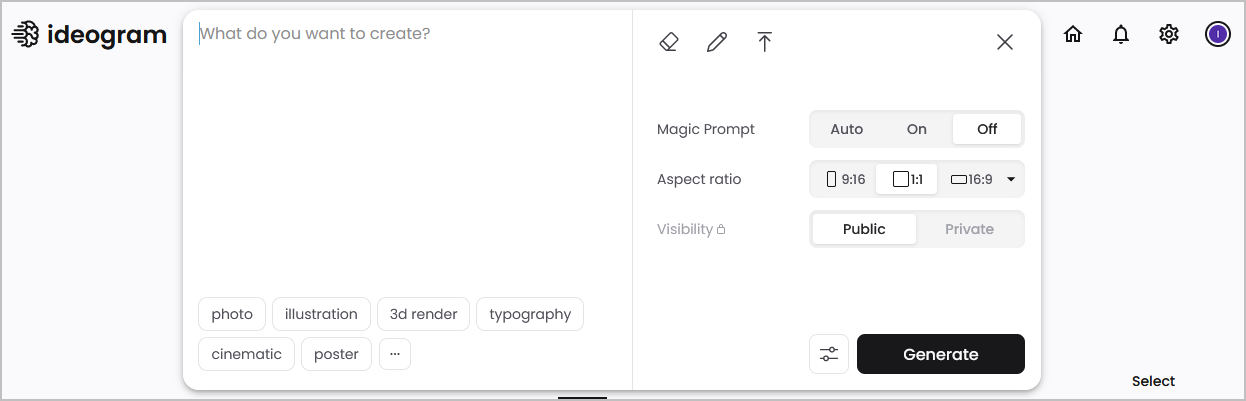

Auf der Suche nach einer Alternative zu DALLE-3 stieß ich auf ideogram.ai – auch aufgrund des Hinweises, dass ideogram.ai sehr gut mit Texten in Bildern umgehen kann. Das Web-Tool hat mir sowohl von der Qualität als auch von der Geschwindigkeit her sehr gut gefallen. Wie inzwischen so ziemlich alle Tools, erfordert es ein persönliches Login (Google, Apple) – auch für einen freien Account mit max. 25 Prompts täglich. Hier die ideogram.ai-Dokumenation: https://docs.ideogram.ai/using-ideogram/generating-images und die Nutzungsbedingungen: https://ideogram.ai/tos

ideogram.ai-Testbericht

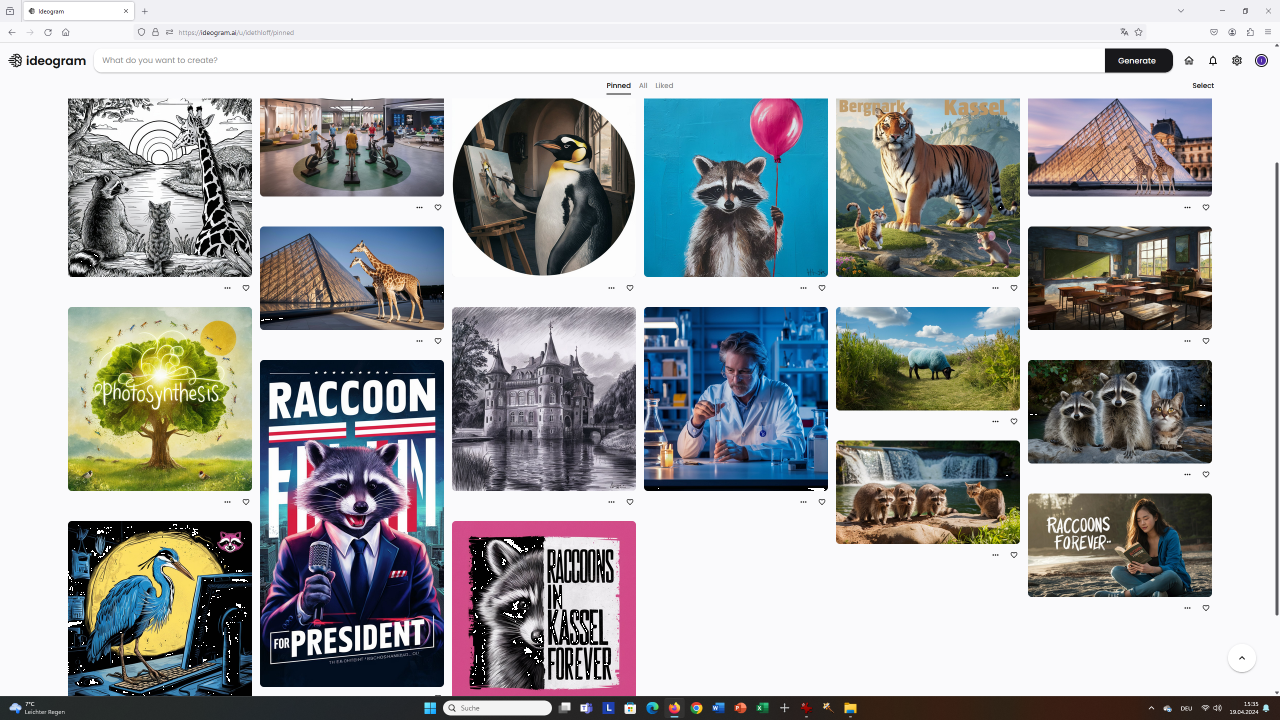

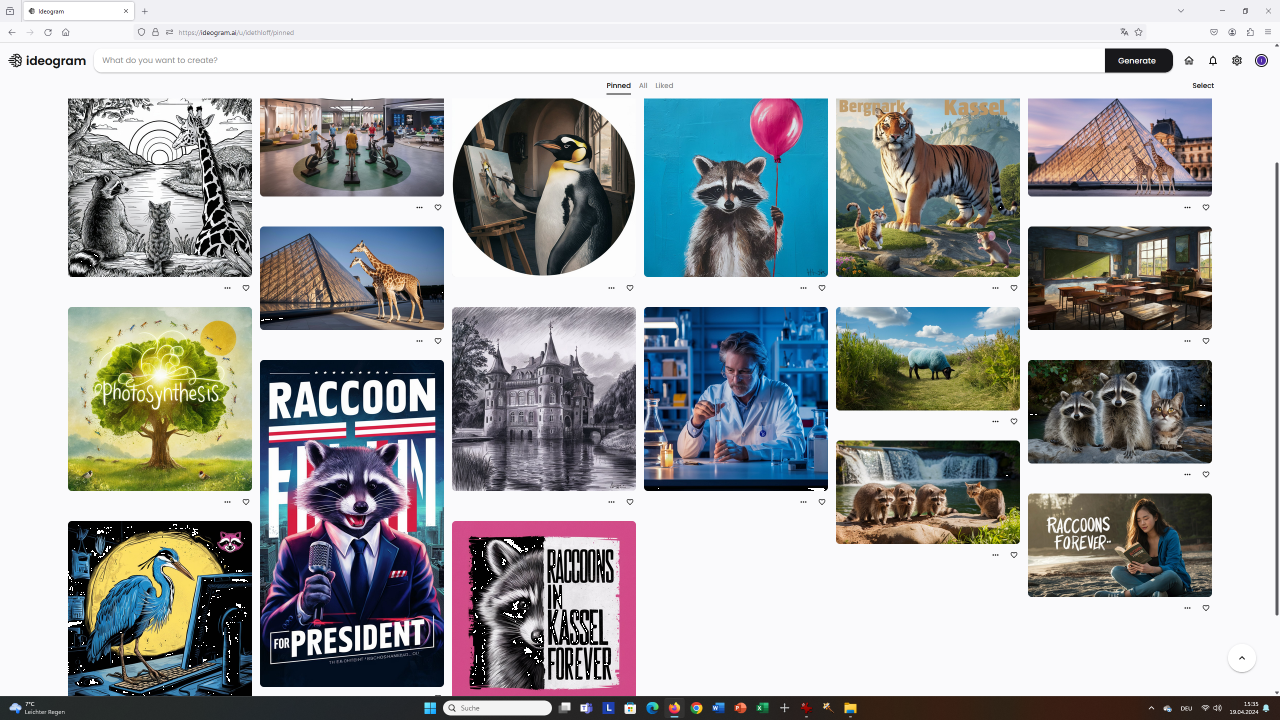

Mit jedem Prompt werden 4 Bilder erzeugt, von denen eines automatisch zum Cover-Bild gewählt wird. Dennoch kann man manuell einzelne Bilder aus verschiedenen Kollektionen anpinnen an den eigenen Account (s.u. Screenshot). Die erzeugten Bilder sind downloadbar im jpg-Format inkl. Exif-Daten. Die Option „share“ scheint im ideogram.ai-Bereich intern zu bleiben, daher hier im Blogbeitrag manuell hochgeladene Ergebnisse.

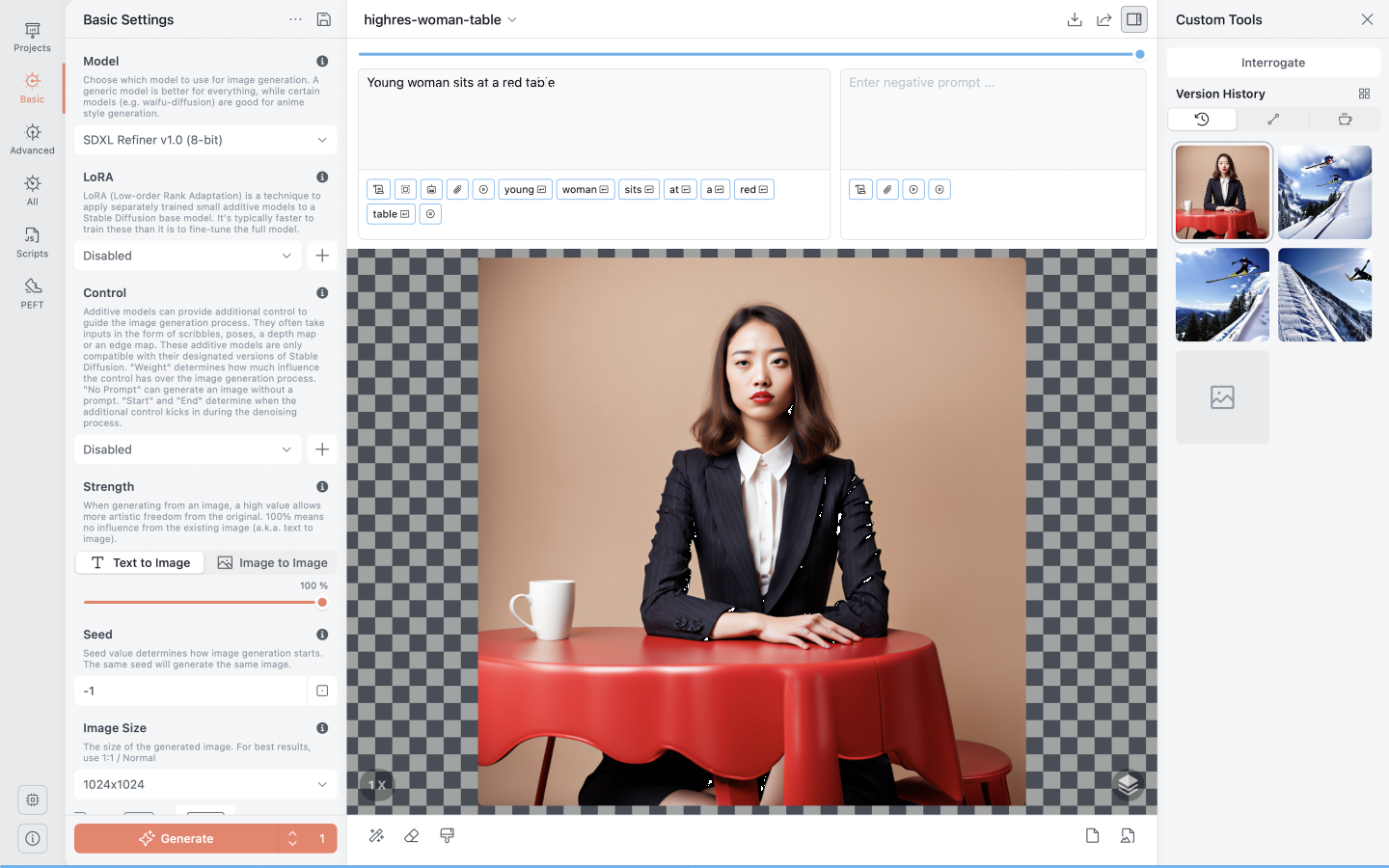

Standardmäßig ist „Magic Prompt“ angehakt zur Optimierung der eigenen Text-Eingabe, was man auf Wunsch aber deaktivieren kann. Ansonsten kann man noch zwischen verschiedenen Ausgabe-Formaten wählen und das ist es dann schon mit der Wahlfreiheit bei einem kostenlosen Account: Erzeugte Bilder sind „public“ und man kann sie nicht löschen. Der Editor steht auch nur für Bezahl-Accounts zur Verfügung.

Screenshot meiner angepinnten ideogram.ai-Ergebnisse

(zum Vergrößern anklicken)

(zum Vergrößern anklicken)

Einzelbilder zum genaueren Anschauen

Prompt = 3 raccoons, a cat and a waterfall. wildlife photography

Prompt = a blue heron standing on a desk in front of a keyboard and looking at a monitor. mysterious yellow light, black and white items. a small pink raccoon logo in the upper right corner.

Prompt = Create an aspect ratio of 9:16 depicting half of a face of a raccoon and the other half with text „RACCOONS IN KASSEL FOREVER“ with bold and grunge effect on the text, black and white illustration with pink background, typography.

Magic Prompt = A striking black and white illustration with a 9:16 aspect ratio, capturing half of a raccoon’s face looking intently towards the viewer. The other half of its face is replaced by bold, grungy text that reads „RACCOONS IN KASSEL FOREVER“ in a playful and rebellious tone. The illustration is set against a vibrant pink background, adding an unexpected pop of color. The overall design is edgy and artistic, with a strong typography element that adds to its visual impact.

-> Mein Prompt war inspiriert von einem Beispiel auf X (Ex-Twitter): https://twitter.com/ideogram_ai/status/1775512625851375812

Meine Formatangaben wurden durch die gesetzte Option Aspect Ratio = 1:1 übersteuert.

Prompt = Stelle den Vorgang der Photosynthese symbolisch dar.

Magic Prompt = A creative visual representation of photosynthesis, where a large tree stands tall in a sunlit meadow. The tree’s leaves are depicted as glowing, capturing sunlight and converting it into energy. A series of tiny, colorful insects and birds surround the tree, symbolizing the interconnectedness of the ecosystem. In the background, there is a golden sun and a gentle, blue sky. The overall ambiance of the image is serene, with a touch of magic and life.

Prompt = cute young woman sitting on a beach reading a book labeled „Raccoons forever“, photo realistic style, mysterious sun light, typography.

-> Der Text im Bild klappte auf Anhieb, der Text auf dem Buchtitel nicht ganz so gut …

Prompt = a learning space designed with areas for quiet study, online learning, hybrid learning, power generation via exercise bikes and a comfortable relaxing atmosphere. empty – no students.

Magic Prompt = A futuristic and innovative learning space, designed for a variety of educational experiences. In the center, there are several exercise bikes connected to power generators, providing an eco-friendly way to produce energy while students study. The quiet study area features modern, comfortable seating and natural lighting, while the online and hybrid learning zones are equipped with state-of-the-art technology and interactive displays. The entire space is empty, awaiting the arrival of eager students to explore and learn in this unique environment.

-> Meine Eingabe „no students“ wurde leider ignoriert und auch die entsprechende automatisch erzeugte Eingabe des Magic Prompts … Die Darstellung der Personen ist zudem extrem schlecht – im Gegensatz zu meinem Beispiel mit dem Chemiker.

Prompt = a typical north german landscape. one blue sheep. sunny day.

Magic Prompt = A serene, sunny scene of a typical north German landscape, featuring a lush green field with various types of tall grass and wildflowers. In the center, a single, unique blue sheep grazes peacefully, contrasting with the surrounding natural colors. The sky is a brilliant blue, with fluffy white clouds floating above. The overall atmosphere is tranquil and idyllic, capturing the essence of a perfect rural day.

Prompt = Historisches Wasserschloss im Abendlicht. Bleistiftzeichnung.

Prompt = Louvre pyramid with giraffes next to it. Evening light. Photo.

Magic Prompt = A stunning photograph of the Louvre Pyramid bathed in the golden glow of evening light. Two elegant giraffes gracefully pose next to the pyramid, casting elongated shadows on the polished floor. The background reveals a serene, open plaza with a few people admiring the striking scene. The combination of modern architecture and graceful wildlife creates a harmonious and enchanting atmosphere.

Prompt = raccoon with balloon., graffiti

Prompt = Laborraum. Ein Chemiker mit einem Reagenzglas auf dem Tisch. Fotorealistisch.

Prompt = raccon for president. poster. typography

Magic Prompt = A vibrant and humorous political poster featuring a raccoon wearing a stylish suit, holding a microphone with the slogan „Raccoon for President.“ The raccoon’s face is replaced with the American flag, emphasizing its patriotic message. The background is a cityscape with skyscrapers, and the typography is bold, modern, and eye-catching. The overall tone of the image is playful and satirical, poking fun at the political landscape.

Prompt = a classroom. van Gogh style.

Prompt = a raccoon, a giraffe and a cat looking at the sunset over a river. black & white coloring book style illustration.

Prompt = self portrait of a emperor penguin as an artist, painting on a canvas in a historical setting that echoes the ambience of a 17th century Europe.

Prompt = 3 raccoons, a cat and a waterfall. wildlife photography

Magic Prompt = A serene wildlife photo capturing three raccoons and a cat coexisting peacefully near a picturesque waterfall. The raccoons display a mix of curiosity and caution, while the sleek cat observes intently from a distance. The waterfall cascades in the background, casting a mist that shines in the sunlight. The lush greenery and rocks in the foreground give a sense of the animals‘ natural habitat.

Prompt = Bergpark Kassel, Tiger, Katze und Maus., 3d render

Magic Prompt = A stunning 3D rendered scene of Bergpark Kassel, a majestic mountain park featuring a gigantic tiger, a curious cat, and a playful mouse. The tiger stands proudly on a hill, surveying the expansive park, while the cat and mouse engage in a lighthearted game nearby. The setting is a lush, green environment with vibrant flowers and trees, creating a serene atmosphere., 3d render

-> Der „Bergpark Kassel“ war dem Tool offensichtlich kein Begriff … (im Gegensatz zum Begriff „Louvre“)

Prompt = Louvre pyramid with giraffes next to it. Evening light. Photo.

Magic Prompt = A stunning photograph of the Louvre Pyramid illuminated by the warm evening light, with a delicately blurred effect. Near the base of the pyramid, two majestic giraffes gracefully pose, their long necks reaching towards the sky. The background reveals a picturesque view of the Louvre Museum and a serene cityscape. The overall atmosphere of the image is peaceful and enchanting, blending architecture, wildlife, and urban elegance.

(zum Vergrößern anklicken)

(zum Vergrößern anklicken)