„Turn your ideas into songs with Suno on Microsoft Copilot“ – Das war eine Headline letzte Woche im Microsoft-Blog (Link Microsoft Blog).

Meine Tests basierten natürlich immer auf Waschbär-Prompts, meinem Markenzeichen für KI-Tests. Die schnell erzeugten Ergebnisse mit ihren jeweiligen Songausschnitten < 1min sind hier im Folgenden aufgelistet.

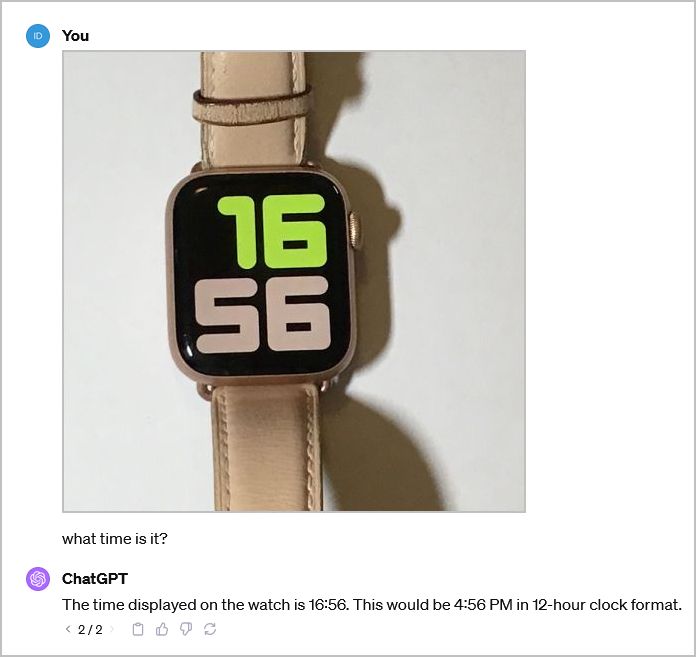

Beispiel 1 (Screenshot)

„Erstelle mir einen Pop-Song mit einem Waschbär, der in der Stadt Kassel auf Wohnungssuche ist.“

[Verse]

Ich bin ein kleiner Waschbär in der Stadt Kassel

Auf Wohnungssuche, doch es ist nicht einfach (nicht einfach)

Ich suche Wärme und ein gemütliches Zuhause

Doch immer wieder hör‘ ich ein trauriges „Nein“ (oh-oh-oh)

[Chorus]

Ich bin ein Waschbär in der Stadt (Stadt)

Suche nach einem Platz zum Leben (Leben)

Doch keiner lässt mich rein (rein)

Ich finde keinen Ort zum Verweilen (weilen)

Doch ich geb‘ nicht auf (nicht auf)

Ich bleibe stark und werd‘ nicht verzagen (ja, ja)

Ein kleiner Waschbär auf Wohnungssuche in Kassel (oh-oh-oh-oh)

MP3-Ergebnis Copilot&Suno – Beispiel 1:

Beispiel 2 (Screenshot)

„Erstell mir einen Song über einen Waschbär, der in Kassel eine Wohnung sucht. Country-Music-Style. Ironischer Text.“

Verse]

In Kassel da war ein Waschbär froh und munter

Er suchte ’ne Wohnung, doch er fand keine Winterunterkunft

Er fragte die Leute, ob sie ihm helfen könnten

Doch keiner will den Waschbär bei sich drinn haben

[Chorus]

Waschbär auf Wohnungssuche (Waschbär)

In Kassel keine Wohnung (oh nein)

Mit Fell so weich und süß (so süß)

Doch hier will ihn niemand (niemand)

Waschbär auf Wohnungssuche (Waschbär)

Oh bitte helft dem kleinen Kerl (bitte!)

Ein Leben ohne Heim ist nicht fair (nicht fair)

Oh bitte helft dem Waschbär, ja

MP3-Ergebnis Copilot&Suno – Beispiel 2:

Beispiel 3 (Screenshot)

„can you compose a song (text and audio) about a racoon looking for a flat in Kassel?“

[Verse]

In the city of Kassel, where the streets are so grand

There’s a raccoon on a mission, with a dream in his hand

He’s looking for a flat, a place to call his own

No dumpsters or trash cans, a cozy little zone

[Chorus]

Oh, raccoon in the city, with your furry little mask (ooh-yeah)

Searching high and low, for a home that’s gonna last

Through the hustle and bustle, you’re on a quest so true

Raccoon in the city, we’re all rooting for you (ooh-yeah)

MP3-Ergebnis Copilot&Suno – Beispiel 3:

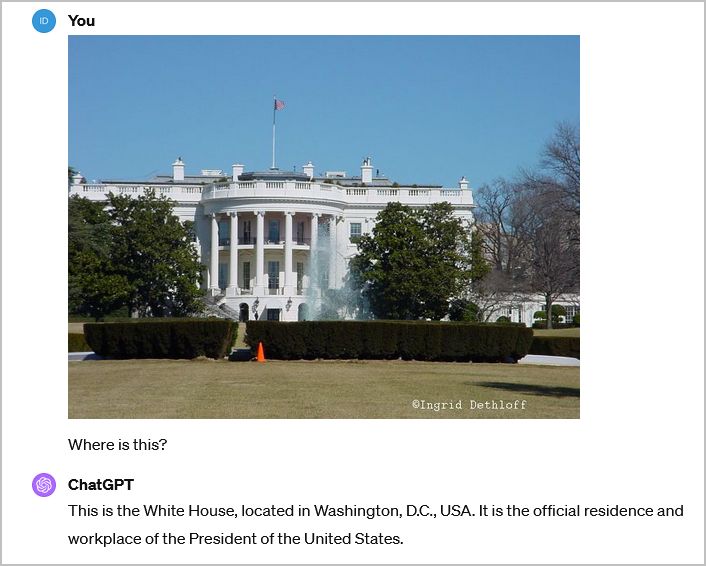

Die in Copilot erzeugten Songbeispiele kann man dann auch als Link teilen wie hier z.B.

Anhören auf Microsoft/Suno https://sl.bing.net/jaK3AzD2Fci

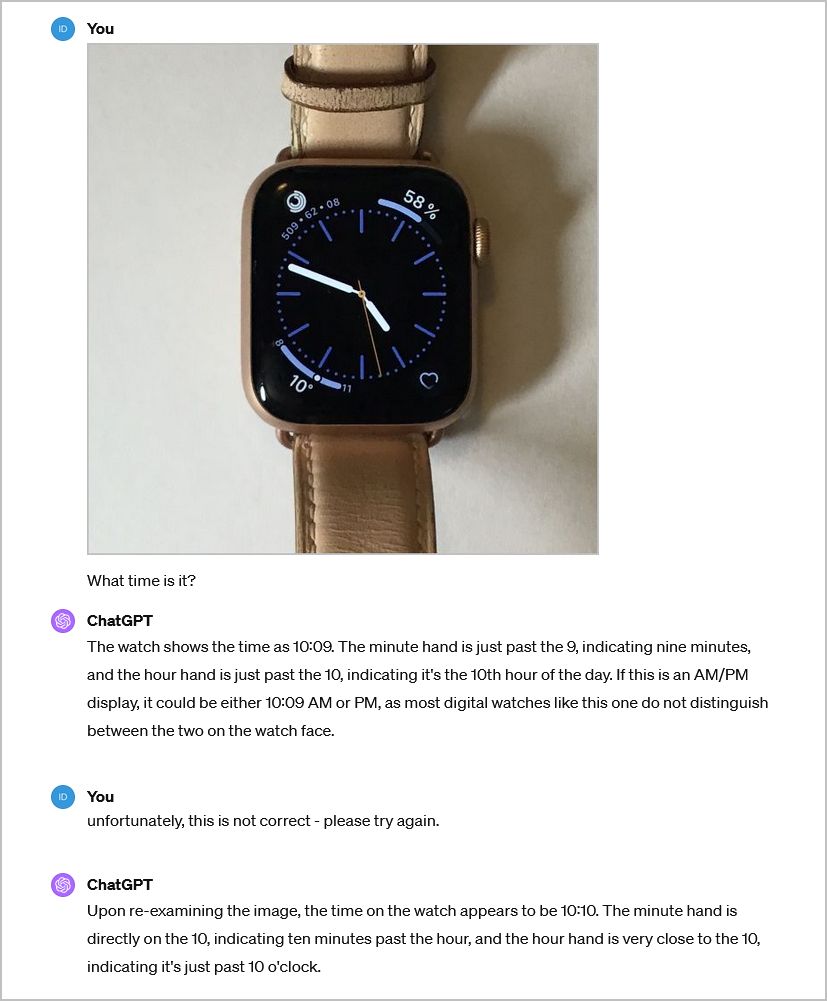

Das im Handelsblatt KI Briefing vom 22.12.23 erwähnte Verfahren, direkt auf der Website Suno.ai einen Song erstellen zu lassen, habe ich nicht getestet. Und etwas überraschend für mich war, dass innerhalb ChatGPTPlus m.W.n. derzeit keine Möglichkeit existiert, Ideen in Songtexte und Songs zu verwandeln.